Zmowa

2000 Jan 01

See all posts

Zmowa

Specjalne podziękowania dla Glena Weyla, Phila Daiana i Jinglana

Wanga za recenzję, i dla Dawida Kurdziela i bichvan2408 za

tłumaczenie

W ciągu ostatnich kilku lat wzrosło zainteresowanie wykorzystaniem

rozmyślnie skonstruowanych bodźców ekonomicznych i mechanizmów

zaprojektowanych w celu dostosowania zachowania uczestników w różnych

kontekstach. W przestrzeni blockchain konstrukcja mechanizmu przede

wszystkim zapewnia bezpieczeństwo samego łańcucha bloków, zachęcając

górników lub walidatorów proof of stake do uczciwego udziału, ale

ostatnio jest on stosowany w rynkach

prognoz, „tokenowo

nadzorowanych rejestrach" i wielu innych kontekstach. Powstający ruch RadicalXChange zainicjował w

międzyczasie eksperymenty z podatkami

Harbergera, głosowaniem kwadratowym, finansowaniem

kwadratowym i in. W ostatnim czasie wzrosło również zainteresowanie

wykorzystaniem bodźców opartych na tokenach w celu promowania wysokiej

jakości postów w mediach społecznościowych. Jednakże w miarę jak rozwój

tych systemów przechodzi z teorii do praktyki, pojawia się szereg

wyzwań, którym należy stawić czoła, a których, jak sądzę, jeszcze

wystarczająco nie rozpoznano. Świeżym przykładem tego przejścia od

teorii do wdrożenia jest Bihu, chińska platforma, która niedawno

wypuściła oparty na monetach mechanizm zachęcania ludzi do pisania

postów. Podstawowym mechanizmem (patrz white paper w języku chińskim tutaj)

jest to, że jeśli użytkownik platformy posiada żetony KEY, ma możliwość

postawienia tych żetonów na artykuły; każdy użytkownik może oddać

k „głosów poparcia" dziennie, a „waga" każdego głosu

poparcia jest proporcjonalna do stawki użytkownika, który oddał głos.

Artykuły z większą ilością udziałów w głosach poparcia są bardziej

widoczne, a autor artykułu otrzymuje nagrodę w postaci tokenów KEY mniej

więcej proporcjonalną do ilości głosów KEY popierających ten artykuł.

Jest to wielkie uproszczenie, a rzeczywisty mechanizm ma w sobie pewne

nieliniowości, ale nie są one niezbędne dla podstawowego funkcjonowania

mechanizmu. KEY ma wartość, ponieważ może być używany na różne sposoby

wewnątrz platformy, ale przede wszystkim procent wszystkich przychodów z

reklam wykorzystywany jest do zakupu i spalania KEY (hura, wielkie brawa

dla nich za to, a nie robienie jeszcze jednego medium do wymiany tokenów!). Ten

rodzaj konstrukcji jest daleki od unikalności; zachęcanie do tworzenia

treści online jest czymś, na czym bardzo wielu ludziom zależy i było

wiele projektów o podobnym charakterze, jak również kilka dość

odmiennych. I w tym przypadku ta konkretna platforma jest już w znacznym

stopniu wykorzystywana:

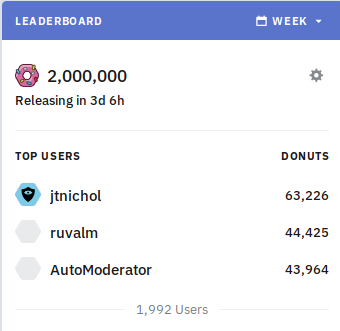

Kilka miesięcy temu, handlujący Ethereum subreddit /r/ethtrader wprowadził nieco

podobną eksperymentalną funkcję, dzięki której token o nazwie „pączek"

jest wydawany użytkownikom wyrażającym komentarze otrzymujące głosy

poparcia, z ustaloną ilością pączków wydawanych tygodniowo użytkownikom

proporcjonalnie do tego, ile głosów poparcia otrzymał ich komentarz.

Pączki mogą być wykorzystane do zakupu prawa do umieszczenia treści

bannera na górze subredditu, a także do głosowania w sondażach

społecznościowych. Jednakże, w przeciwieństwie do tego, co dzieje się w

systemie KEY, tutaj nagroda, którą otrzymuje B, gdy A zagłosuje na B,

nie jest proporcjonalna do istniejącej liczby monet należących do A;

zamiast tego, każde konto Reddit ma równą możliwość wpłaty na inne konta

Reddit.

Tego rodzaju eksperymenty próbujące nagradzać tworzenie treści

wysokiej jakości w sposób wykraczający poza znane ograniczenia

darowizn/mikropłatności są bardzo cenne. Niedocenianie treści

internetowych generowanych przez użytkowników jest istotnym problemem w

społeczeństwie w ogóle (patrz „radykalizm

liberalny" i „dane jako

praca"). Otuchy dodaje fakt, że kryptospołeczności próbują

wykorzystać siłę konstrukcji mechanizmu, by wejść na drogę do jego

rozwiązania. Ale niestety, te systemy są również podatne na

atak. Samogłosowanie, plutokracja i łapówki

Oto jak można ekonomicznie zaatakować zaproponowany powyżej projekt.

Załóżmy, że jakiś zamożny użytkownik nabywa pewną ilość N

tokenów, a w rezultacie każdy z jego k głosów daje odbiorcy

nagrodę w wysokości N * q (q tutaj

prawdopodobnie jest to bardzo mała liczba, np.

q = 0,000001). Użytkownik po prostu głosuje na swoje własne

konta kukiełkowe, dając sobie nagrodę w wysokości

N * k * q. Następnie system po prostu się załamuje, a każdy

użytkownik otrzymuje „stopę procentową" w wysokości k * q

za okres, a mechanizm nie osiąga nic innego. Rzeczywisty mechanizm Bihu

zdawał się to przewidywać i ma pewną superliniową logikę, w której

artykuły z większą ilością głosów poparcia KEY uzyskują

nieproporcjonalnie większą nagrodę, pozornie zachęcając raczej do

poparcia popularnych postów niż do samodzielnego głosowania. Powszechnym

wzorcem wśród systemów zarządzania głosowaniem za pomocą monet jest

dodawanie tego rodzaju superliniowości, aby zapobiec osłabianiu całego

systemu przez samogłosowanie. Większość systemów DPOS posiada

ograniczoną liczbę slotów dla delegatów z zerowymi nagrodami dla

każdego, kto nie otrzyma wystarczającej liczby głosów, aby dołączyć do

jednego z slotów, z podobnym skutkiem. Jednak systemy te niezmiennie

wprowadzają dwie nowe słabości:

- Subsydiują plutokrację, ponieważ bardzo zamożne

osoby i kartele nadal mogą uzyskać wystarczająco dużo środków, aby

samodzielnie głosować.

- Mogą one zostać ominięte przez użytkowników *** przekupujących***

innych użytkowników, aby głosować na nich masowo.

Ataki łapówkarskie mogą brzmieć zbyt przesadnie (kto tu kiedykolwiek

w życiu przyjął łapówkę?), ale w dojrzałym ekosystemie są o wiele

bardziej realistyczne, niż się wydaje. W większości kontekstów, w których łapówki

miały miejsce w przestrzeni blockchain, operatorzy używają

eufemistycznej nowej nazwy, aby nadać koncepcji przyjazną twarz: to nie

jest łapówka, to „staking pool", która „rozdziela dywidendę". Łapówki

można nawet zatuszować: wyobraź sobie kantor wymiany kryptowalut, który

oferuje zerowe opłaty i wydaje pieniądze na niezwykle dobry interfejs

użytkownika i nawet nie próbuje zebrać zysku. Zamiast tego używa monet,

które użytkownicy wpłacają, aby uczestniczyć w różnych systemach

głosowania za pomocą monet. Nieuchronnie pojawią się również ludzie,

którzy będą postrzegać zmowę w grupie jako zwykłą, normalną rzecz.

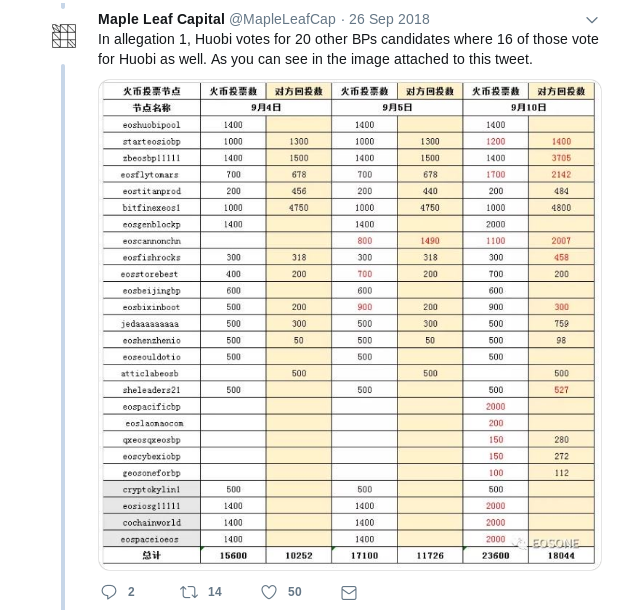

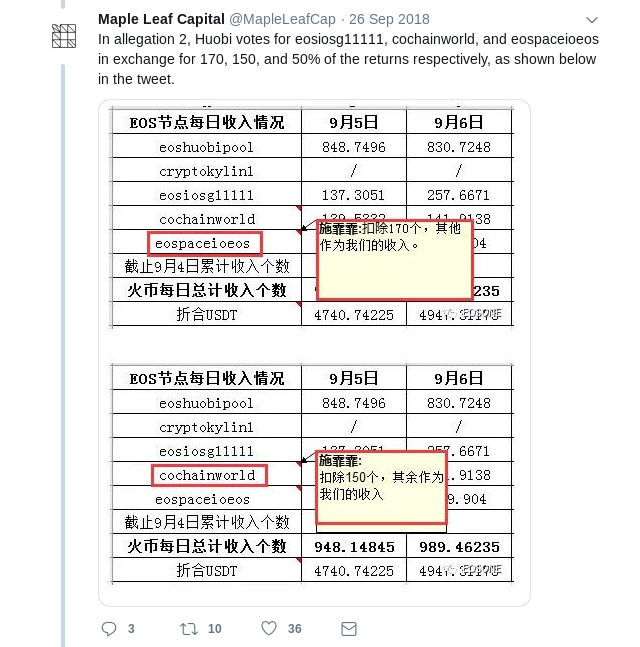

Przykładem może być niedawny skandal

z udziałem EOS DPOS:

W końcu istnieje możliwość „negatywnej łapówki", tzn. szantażu lub

przymusu, grożąc uczestnikom krzywdą, chyba że zadziałają oni w

określony sposób wewnątrz mechanizmu. W eksperymencie /r/ethtrader

strach przed ludźmi przychodzącymi i kupującymi pączki w celu

zmiany sondaży zarządzających doprowadził do tego, że społeczność

zdecydowała się na stworzenie tylko zablokowanych (tj. niepodlegających

wymianie handlowej) pączków uprawnionych do wykorzystania w głosowaniu.

Ale jest jeszcze tańszy atak niż kupowanie pączków (atak, który można

uznać za rodzaj zamaskowanej łapówki): wynajmowanie ich. Jeśli

napastnik posiada już ETH, może użyć go jako zabezpieczenia na

platformie takiej jak Compound,

aby pożyczyć jakiś token, dając Ci pełne prawo do użycia tego tokena w

dowolnym celu, włączając w to udział w głosowaniu. Kiedy to zrobi, po

prostu odsyła tokeny z powrotem do kontraktu pożyczki, aby odzyskać

swoje zabezpieczenie - wszystko to bez konieczności znoszenia nawet

jednej sekundy ekspozycji cenowej na token, którego użył do oddania

głosu monetą, nawet jeśli mechanizm głosowania monetą zawiera blokadę

czasową (jak np. Bihu). W każdym przypadku problemy związane z

łapówkarstwem i przypadkowe nadmierne wzmocnienie dobrze powiązanych i

zamożnych uczestników okazują się zaskakująco trudne do uniknięcia.

Tożsamość Niektóre systemy próbują złagodzić

plutokratyczne aspekty głosowania monetami poprzez wykorzystanie systemu

tożsamości. W przypadku systemu pączków /r/ethtrader, na przykład,

sondaże zarządzające są wprawdzie przeprowadzane za pomocą

głosowania monetami, jednak mechanizm, który decyduje o tym, jak

dużo pączków (tj. monet) otrzymujesz w pierwszej kolejności oparty

jest na kontach Reddit: 1 głos poparcia z 1 konta Reddit = N zarobionych

pączków. Idealnym celem systemu tożsamości jest sprawienie, by uzyskanie

przez jednostkę jednej tożsamości było stosunkowo łatwe, natomiast

uzyskanie wielu tożsamości - stosunkowo trudne. W systemie pączków

/r/ethtrader są to konta Reddit, a w gadżecie dopasowującym Gitcoin CLR

używane są konta Githuba. Ale tożsamość, przynajmniej dotychczas

implementowana, jest delikatną rzeczą...

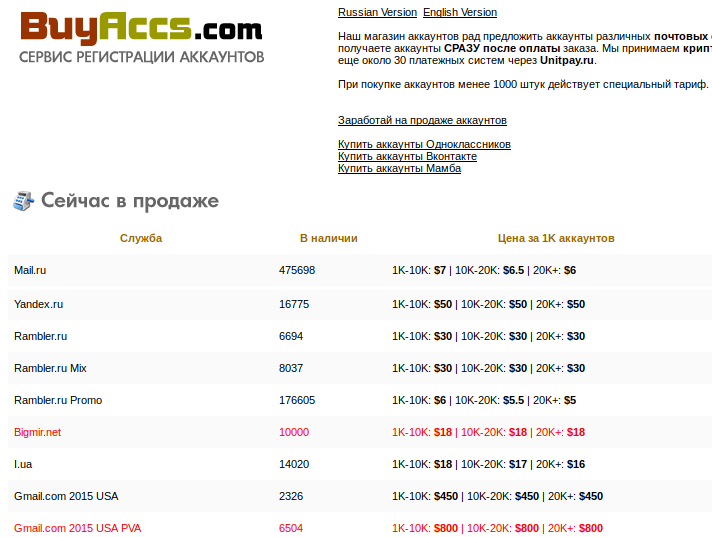

Och, jesteś zbyt leniwy, żeby zrobić duży stojak z telefonami? Cóż,

może szukasz tego:

Zwykłe ostrzeżenie o możliwych nieuczciwych praktykach na tych

stronach jest tego warte: przeprowadzaj własne badania i zachowaj

czujność.

Prawdopodobnie, atakowanie tych mechanizmów poprzez zwykłe

kontrolowanie tysięcy fałszywych tożsamości jak władca marionetek jest

nawet łatwiejsze niż konieczność przekupywania ludzi. A jeśli

uważasz, że odpowiedzią jest po prostu zwiększenie bezpieczeństwa do

poziomu rządowych dokumentów tożsamości? Cóż, jeśli chcesz

zdobyć kilka z nich, możesz zacząć poszukiwania tutaj ale pamiętaj, że

istnieją wyspecjalizowane organizacje przestępcze, które są daleko przed

tobą. Nawet jeśli wszystkie struktury przestępcze zostałyby rozbite,

istnieją wrogie rządy, które na pewno stworzą miliony sfałszowanych

paszportów, jeśli będziemy na tyle głupi, by stworzyć systemy, które

sprawią, że tego rodzaju działalność będzie opłacalna. I nie obejmuje to

nawet ataków w odwrotnym kierunku, gdy instytucje wydające dokumenty

tożsamości próbują zepchnąć na margines społeczności poprzez

odmawianie im dokumentów tożsamości... Zmowa Biorąc pod uwagę, że

tak wiele mechanizmów wydaje się podobnie zawodzić, kiedy w grę wchodzi

wiele tożsamości lub nawet płynnych rynków, można zapytać, czy istnieje

jakiś głęboki wspólny aspekt, który powoduje te wszystkie problemy?

Twierdzę, że odpowiedź brzmi „tak", a „wspólny aspekt" jest następujący:

o wiele trudniejsze, a zapewne wręcz niemożliwe jest stworzenie

mechanizmów, które zachowują pożądane właściwości w modelu, w którym

uczestnicy mogą się zmawiać, niż w modelu, w którym nie mogą. Większość

ludzi prawdopodobnie ma już pewne przeczucia na ten temat; konkretne

realizacje tej zasady są źródłem dobrze ugruntowanych norm i często

przepisów prawa promujących konkurencję na rynku i ograniczających

działania karteli ustalających ceny, kupowanie i sprzedawanie głosów

oraz przekupstwo. Ale problem jest o wiele głębszy i bardziej

powszechny. W tej wersji teorii gier, która skupia się na indywidualnym

wyborze - czyli w wersji, która zakłada, że każdy uczestnik podejmuje

decyzje samodzielnie i która nie dopuszcza możliwości pracy grup agentów

działających wspólnie dla wzajemnych korzyści, istnieją matematyczne

dowody, że w każdej grze musi istnieć przynajmniej jedna stabilna

równowaga Nasha, a projektanci mechanizmów mają bardzo dużą swobodę w

„konstruowaniu" gier, aby osiągnąć konkretne wyniki. Ale w wersji teorii

gier, która dopuszcza możliwość koalicji pracujących razem, zwanej

teorią gier kooperacyjnych, istnieją duże

klasy gier które nie mają stabilnego wyniku, od

którego koalicja nie może się zyskownie różnić. Gry

większościowe - formalnie opisane jako gry N agentów,

gdzie dowolny podzbiór ponad połowy z nich może zdobyć stałą nagrodę i

podzielić ją między sobą; konfiguracja bardzo podobna do wielu sytuacji

w zakresie ładu korporacyjnego, polityki i wielu innych sytuacji z życia

człowieka - są częścią

tego zbioru z natury niestabilnych gier. Oznacza to, że jeśli

istnieje sytuacja z pewną stałą pulą zasobów i pewnym obecnie ustalonym

mechanizmem ich dystrybucji, a 51% uczestników może nieuchronnie

spiskować w celu przejęcia kontroli nad zasobami, bez względu na to,

jaka jest obecna konfiguracja, zawsze może pojawić się jakiś spisek,

który byłby korzystny dla uczestników. Spisek ten byłby jednak z kolei

narażony na potencjalne nowe konspiracje, w tym być może kombinację

poprzednich spiskowców i ofiar... i tak dalej i tak dalej.

| 1 |

1/3 |

1/3 |

1/3 |

| 2 |

1/2 |

1/2 |

0 |

| 3 |

2/3 |

0 |

1/3 |

| 4 |

0 |

1/3 |

2/3 |

Ten fakt, niestabilność gier większościowych w ramach teorii

gier kooperacyjnych, jest prawdopodobnie bardzo niedoceniany jako

uproszczony ogólny model matematyczny wyjaśniający, dlaczego w polityce

nie może być żadnego „końca historii" i żadnego systemu, który okazałby

się w pełni zadowalający. Osobiście uważam, że jest on o wiele bardziej

użyteczny niż bardziej znane twierdzenie

Arrowa, na przykład. Są dwa sposoby na

obejście tego problemu. Pierwszym z nich jest próba ograniczenia nas

samych do klasy gier, które są „wolne od tożsamości" i „odporne

na zmowy", żebyśmy nie musieli martwić się ani o łapówki, ani o

tożsamość. Drugim jest bezpośrednie zajęcie się problemami tożsamości i

odporności na zmowy i rzeczywiste rozwiązanie ich wystarczająco dobrze,

aby wdrożyć gry bez zmowy, oferujące lepsze funkcje. Projekt gry

bez tożsamości i odpornej na zmowy.Klasa gier wolnych od

tożsamości i odpornych na zmowy ma zasadnicze znaczenie. Nawet proof of

work jest odporny na zmowy aż do momentu, w którym jeden aktor ma ~23,21% całkowitej mocy

haszowania, a ta wartość może być zwiększona do 50% przy użyciu sprytnej inżynierii.

Rynki konkurencyjne są całkiem odporne na zmowy do stosunkowo wysokiej

wartości granicznej, która w niektórych przypadkach jest łatwo

osiągalna, a w innych nie. W przypadku nadzorowania i

kontroli treści (które tak naprawdę są tylko szczególnymi

przypadkami ogólnego problemu identyfikacji publicznych dóbr i

publicznych krzywd) główną klasą dobrze funkcjonującego mechanizmu jest

futarchia

- zazwyczaj przedstawiana jako „zarządzanie przez rynek prognostyczny",

choć twierdzę również, że korzystanie z depozytów zabezpieczających jest

zasadniczo w tej samej klasie technologii. Sposób, w jaki działają

mechanizmy futarchii, w swojej najbardziej ogólnej formie, polega na

tym, że „głosowanie" jest nie tylko wyrażeniem opinii, ale także

przewidywaniem, z nagrodą za tworzenie prawdziwych przepowiedni

i karą za tworzenie fałszywych. Na przykład moja

propozycja dla „rynków przewidywań dla DAO nadzorujących treści"

sugeruje na wpół scentralizowaną konstrukcję, gdzie każdy może

zagłosować lub odrzucić nadesłane treści, z treścią na którą oddaje się

więcej głosów poparcia, gdzie istnieje również „panel moderacyjny",

który podejmuje ostateczne decyzje. Dla każdego wpisu istnieje małe

prawdopodobieństwo (proporcjonalne do całkowitej liczby głosów za i

przeciw na dany wpis), że panel moderacyjny zostanie wezwany do podjęcia

ostatecznej decyzji w sprawie wpisu. Jeśli panel moderacyjny zatwierdzi

dany wpis, każdy, kto go na niego głosował jest nagradzany, a każdy kto

głosował przeciw, jest karany, a jeśli panel moderacyjny nie zatwierdzi

wpisu, następuje sytuacja odwrotna; mechanizm ten zachęca uczestników do

wymyślenia głosów, które starają się „przewidzieć" osąd panelu

moderacyjnego. Innym możliwym przykładem futarchii jest system

zarządzania projektem z użyciem tokena, w którym każdy, kto głosuje za

decyzją, jest zobowiązany do zakupu pewnej ilości tokenów po cenie w

momencie rozpoczęcia głosowania, jeśli głosowanie wygra. Gwarantuje to,

że głosowanie za złą decyzją jest kosztowne, a w skrajnych przypadkach,

jeśli zła decyzja wygra głosowanie, każdy kto ją zatwierdził, musi

zasadniczo wykupić wszystkich innych w projekcie. Gwarantuje to, że

indywidualne głosowanie za „niewłaściwą" decyzją może być bardzo

kosztowne dla wyborcy, wykluczając możliwość tanich ataków

łapówkarskich.

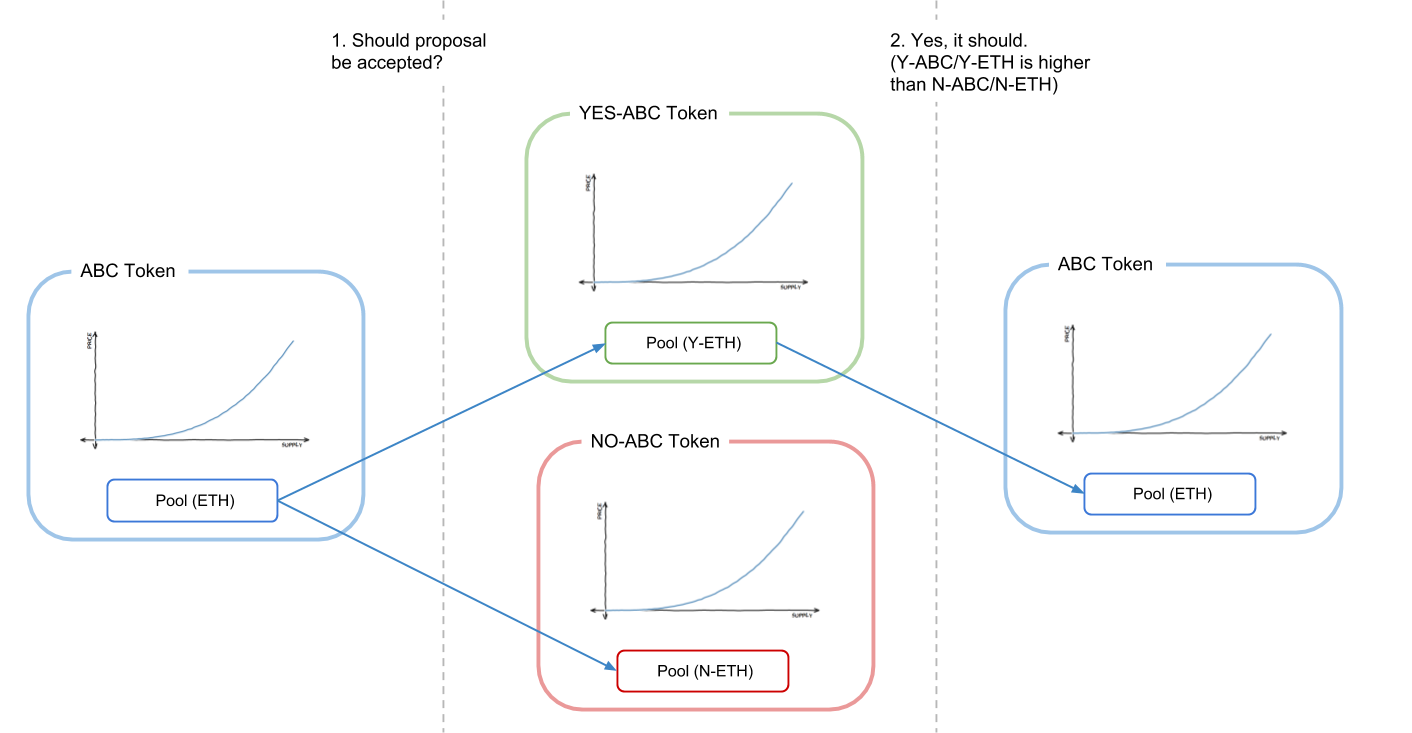

Opis graficzny jednej z form futarchii, tworzącej dwa rynki

reprezentujące dwa „możliwe przyszłe światy" i wybierającej ten, który

ma korzystniejszą cenę. Źródło ten

post na ethresear.ch

Jednak zakres tego, co tego typu mechanizmy mogą robić, jest

ograniczony. W powyższym przykładzie nadzoru treści nie rozwiązujemy tak

naprawdę kwestii zarządzania, po prostu skalujemy

funkcjonalność gadżetu zarządzającego, który już został uznany za godny

zaufania. Można by spróbować zastąpić panel moderacyjny rynkiem

predykcyjnym w oparciu o cenę tokena reprezentującego prawo do zakupu

powierzchni reklamowej, ale w praktyce ceny są zbyt hałaśliwym

wskaźnikiem, aby było to wykonalne dla czegokolwiek oprócz bardzo małej

liczby bardzo dużych decyzji. I często wartość, którą staramy się

zmaksymalizować, jest wyraźnie czymś innym niż maksymalna wartość

monety. Przyjrzyjmy się dokładniej, dlaczego w bardziej ogólnym

przypadku, gdy nie możemy łatwo określić wartości decyzji dotyczącej

zarządzania poprzez jej wpływ na cenę tokena, dobre mechanizmy

identyfikacji dóbr i krzywd publicznych nie mogą być niestety wolne od

tożsamości lub odporne na zmowy. Jeśli ktoś próbuje zachować własność

gry wolnej od tożsamości, budując system, w którym tożsamość nie ma

znaczenia i mają ją tylko monety, istnieje niemożliwy do osiągnięcia

kompromis pomiędzy brakiem zachęt do korzystania z legalnych dóbr

publicznych, a nadmiernym subsydiowaniem plutokracji.

Argumentacja jest następująca. Przypuśćmy, że jest jakiś autor, który

wytwarza dobro publiczne (np. serię postów na blogu), które zapewnia

wartość każdemu członkowi społeczności liczącej 10 000 osób. Przypuśćmy,

że istnieje pewien mechanizm, w którym członkowie społeczności mogą

podjąć działanie powodujące, że autor otrzymuje zysk w wysokości 1\(. O ile członkowie społeczności nie są *niezwykle*

altruistyczni, to aby mechanizm działał, koszt podjęcia tej akcji musi

być znacznie niższy niż 1\), ponieważ w przeciwnym razie część

korzyści odniesionych przez członka społeczności wspierającego autora

byłaby znacznie mniejsza niż koszt wsparcia autora, a więc system popada

w tragedię

wspólnoty, gdzie nikt nie wspiera autora. Dlatego musi istnieć

sposób na to, aby autor zarobił 1$ przy koszcie znacznie mniejszym niż

1\(. Ale teraz załóżmy, że istnieje również

fałszywa społeczność, która składa się z 10 000 fałszywych kont

marionetkowych tego samego bogatego atakującego. Ta społeczność

podejmuje wszystkie te same działania, co prawdziwa społeczność, z

wyjątkiem tego, że zamiast wspierać autora, wspomaga *inne* fałszywe

konto, które jest również marionetką atakującego. Jeśli członek

„prawdziwej społeczności" mógł dać autorowi 1\) przy osobistym

koszcie znacznie mniejszym niż 1$, to jest możliwe by napastnik dał

samemu sobie\(1 przy koszcie znacznie

mniejszym niż 1\) za każdym razem, a tym samym wyczerpał fundusze

systemu. Każdy mechanizm, który może naprawdę pomóc słabo skoordynowanym

stronom w koordynowaniu bez odpowiednich zabezpieczeń, pomoże również

już skoordynowanym stronom (takim jak wiele kont kontrolowanych przez tę

samą osobę) nadmiernie skoordynowanie, wydobywając pieniądze z

systemu. Podobne wyzwanie pojawia się, gdy celem nie jest finansowanie,

ale raczej określenie, jaka treść powinna być najbardziej widoczna. Jaka

treść, twoim zdaniem, otrzymałaby większą wspierającą wartość dolarową:

prawdziwie wysokiej jakości artykuł blogowy przynoszący korzyści

tysiącom ludzi, choć każda osoba korzysta z niego stosunkowo

nieznacznie, czy to?

A może to?

Ci, którzy śledzili niedawne wydarzenia polityczne na świecie, mogą

również wskazać na inny rodzaj treści, który przynosi korzyści wysoce

scentralizowanym aktorom: manipulację mediami społecznościowymi przez

wrogie rządy. Ostatecznie zarówno systemy scentralizowane, jak i

zdecentralizowane stoją przed tym samym fundamentalnym problemem, który

polega na tym, że „rynek idei" (i ogólnie dóbr publicznych) jest

bardzo daleki od „efektywnego rynku" w sensie zwykle używanym przez

ekonomistów, a to prowadzi zarówno do niedoboru dóbr

publicznych nawet w „czasie pokoju", jak i podatności na aktywne ataki.

To po prostu poważny problem. Dlatego też systemy głosowania oparte na

monetach (takie jak Bihu) mają jedną główną przewagę nad systemami

opartymi na tożsamości (jak Gitcoin CLR lub eksperyment z pączkami

/r/ethtrader): przynajmniej nie ma żadnej korzyści z masowego kupowania

kont, ponieważ wszystko, co robisz, jest proporcjonalne do tego ile masz

monet, niezależnie od tego, na ile kont są one podzielone. Jednakże

mechanizmy, które nie opierają się na żadnym modelu tożsamości i

zasadniczo opierają się jedynie na monetach, nie mogą rozwiązać problemu

skoncentrowanych interesów, które wygrywają z rozproszonymi

społecznościami starającymi się wspierać dobra publiczne. Wolny od

tożsamości mechanizm, który wzmacnia rozproszone społeczności, nie może

uniknąć nadmiernego wzmocnienia scentralizowanych plutokratów udających

rozproszone społeczności. Ale nie chodzi tylko o kwestie tożsamości, na

które narażone są również gry związane z dobrami publicznymi; chodzi też

o łapówki. Aby zobaczyć dlaczego, rozważmy ponownie powyższy przykład,

gdzie zamiast „fałszywej społeczności", którą jest 10001 marionetek

atakującego, atakujący ma tylko jedną tożsamość, konto otrzymujące

fundusze, a pozostałe 10 000 kont to prawdziwi użytkownicy - ale

użytkownicy otrzymujący łapówkę po 0,01$ każdy, za podjęcie akcji, która

spowodowałaby, że atakujący zyskałby dodatkowy 1$. Jak wspomniano

powyżej, łapówki te mogą być w znacznym stopniu zatuszowane, nawet

poprzez usługi powiernicze świadczone przez osoby trzecie, które głosują

w imieniu użytkownika w zamian za wygody, a w przypadku modeli

„głosujących monetami" zatuszowanie łapówki jest jeszcze łatwiejsze:

można to zrobić poprzez wypożyczenie monet na rynku i wykorzystanie ich

do udziału w głosowaniu. Zatem, o ile niektóre rodzaje gier, w

szczególności gier opartych na rynku przewidywań lub na depozytach

zabezpieczających, można uczynić odpornymi na zmowy i pozbawionymi

tożsamości, o tyle uogólnione finansowanie dóbr publicznych wydaje się

klasą problemów, w której niestety nie da się zastosować podejścia

odpornego na zmowy i pozbawionego tożsamości. Odporność na zmowy

i tożsamość Inną alternatywą jest atakowanie problemu

tożsamości bezpośrednio. Jak wspomniano powyżej, samo przejście na

scentralizowane systemy tożsamości o wyższym poziomie bezpieczeństwa,

takie jak paszporty i inne rządowe dokumenty tożsamości, nie będzie

działać na dużą skalę; w sytuacji wielu zachęt są one bardzo niepewne i

podatne na zagrożenia ze strony samych rządów wydających dokumenty!

Rodzaj „tożsamości", o której tutaj mówimy, jest raczej pewnego rodzaju

solidnym wieloczynnikowym zbiorem twierdzeń, że aktor identyfikowany

przez pewien zbiór komunikatów jest w rzeczywistości niepowtarzalną

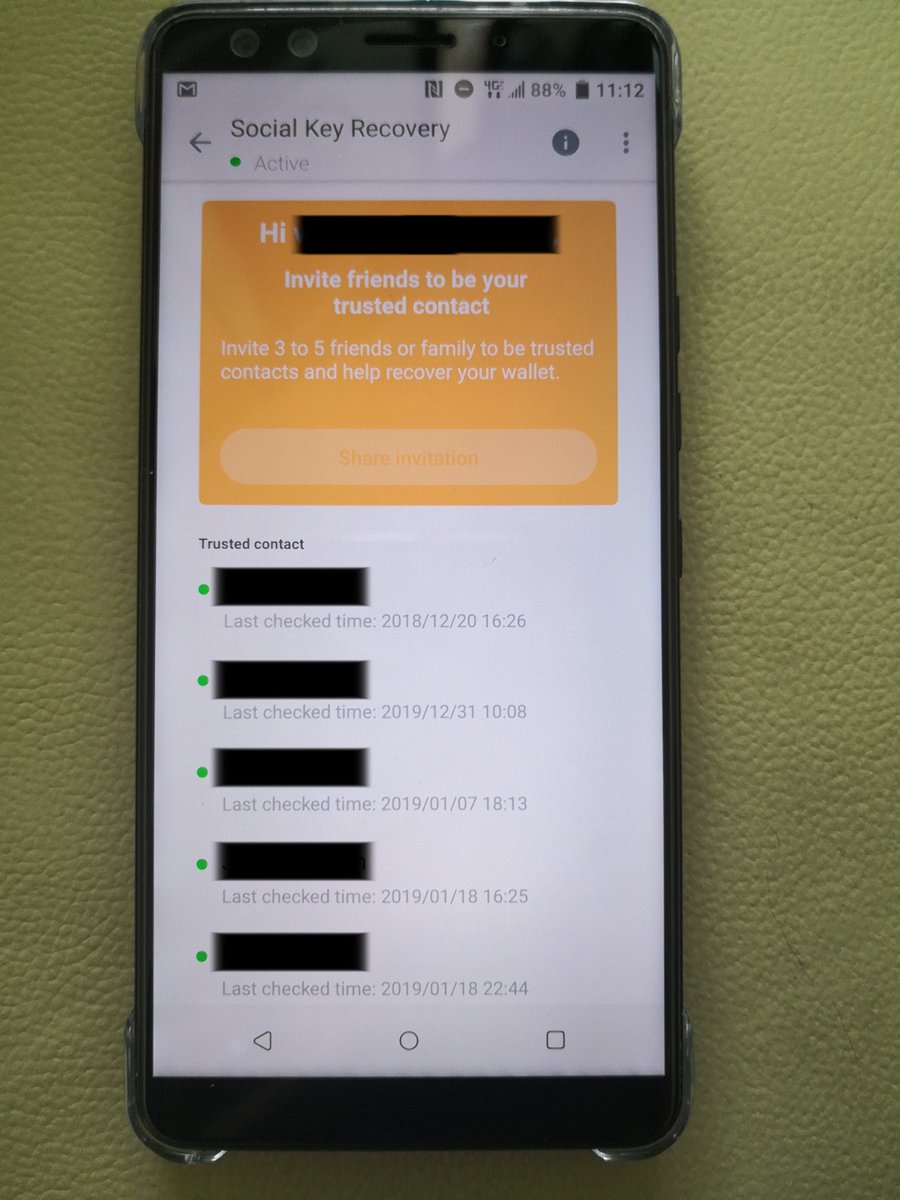

jednostką. Bardzo wczesnym prototypowym modelem tego rodzaju tożsamości

sieciowej jest prawdopodobnie społeczny mechanizm odzyskiwania kluczy w

blockchainowym telefonie HTC:

Podstawową ideą jest to, że Twój klucz prywatny jest podzielony w

tajemnicy pomiędzy maksymalnie pięć zaufanych kontaktów, w taki sposób,

że matematycznie zapewnia, iż trzy z nich mogą odzyskać oryginalny

klucz, ale dwa lub mniej nie mogą. Kwalifikuje się to jako „system

tożsamości" - to piątka Twoich przyjaciół decyduje o tym, czy ktoś, kto

próbuje odzyskać Twoje konto, to Ty, czy nie. Jest to jednak system

tożsamości specjalnego przeznaczenia, próbujący rozwiązać problem -

bezpieczeństwa konta osobistego - który różni się od (i jest łatwiejszy

niż!) problemu próby identyfikacji konkretnych osób. Podsumowując,

ogólny model konkretnych osób składających oświadczenia o sobie nawzajem

może być prawdopodobnie powiązany z jakimś bardziej solidnym modelem

tożsamości. Systemy te mogą być w razie potrzeby rozszerzone przy użyciu

opisanego powyżej mechanizmu „futarchii": jeśli ktoś twierdzi, że ktoś

jest konkretną osobą, a ktoś inny się na to nie zgadza, a obie strony są

skłonne nawiązać współpracę w celu rozstrzygnięcia sprawy, system może

zwołać zespół orzekający w celu ustalenia, kto ma rację. Ale chcemy też

innej niezwykle istotnej własności: chcemy tożsamości, której nie można

wiarygodnie wynająć ani sprzedać. Oczywiście, nie możemy przeszkodzić

ludziom w zawarciu umowy typu „wyślij mi 50 dolarów, a ja wyślę ci mój

klucz", ale możemy spróbować zapobiegać wiarygodności

takich transakcji - zrobić tak, aby sprzedający mógł łatwo oszukać

kupującego i dać mu klucz, który tak naprawdę nie działa. Jednym ze

sposobów dokonania tego jest stworzenie mechanizmu, dzięki któremu

właściciel klucza może wysłać transakcję, która unieważnia klucz i

zastępuje go innym, wybranym przez właściciela, a wszystko to w sposób,

którego nie można udowodnić. Być może najprostszym sposobem na obejście

tego problemu jest albo użycie zaufanej strony, która przeprowadza

obliczenia i publikuje tylko wyniki (wraz z dowodami z wiedzą zerową

potwierdzającymi wyniki, więc zaufana strona jest zaufana tylko dla

prywatności, a nie integralności), albo zdecentralizowanie tej samej

funkcjonalności dzięki wielopodmiotowym

obliczeniom. Takie podejście nie rozwiąże całkowicie problemu zmowy;

grupa przyjaciół mogłaby nadal spotykać się na tej samej kanapie i

koordynować głosowania, ale przynajmniej ograniczy ją w możliwym do

opanowania stopniu, który nie doprowadzi do całkowitego upadku tych

systemów. Jest jeszcze jeden problem: wstępna dystrybucja klucza. Co się

stanie, jeśli użytkownik stworzy swoją tożsamość w zewnętrznym serwisie

powierniczym, który następnie przechowuje klucz prywatny i używa go do

potajemnego głosowania? Byłaby to ukryta łapówka, siła głosu użytkownika

w zamian za dostarczenie użytkownikowi wygodnej usługi, a co więcej,

jeśli system jest bezpieczny w tym sensie, że skutecznie zapobiega

łapówkom poprzez uczynienie głosów niepoprawnymi, tajne głosowanie przez

zewnętrznych gospodarzy byłoby również niewykrywalne. Jedynym

podejściem, które omija ten problem wydaje się... weryfikacja osobista. Na

przykład można mieć ekosystem „emitentów", w którym każdy emitent wydaje

karty elektroniczne z kluczami prywatnymi, które użytkownik może

natychmiast pobrać na swój smartfon i wysłać wiadomość, aby zastąpić

klucz innym kluczem, którego nikomu nie ujawni. Emitentami tymi mogą być

spotkania i konferencje lub potencjalnie osoby, które przez mechanizm

głosowania zostały już uznane za godne zaufania. Budowanie

infrastruktury umożliwiającej tworzenie mechanizmów odpornych na zmowy,

w tym solidnych, zdecentralizowanych systemów tożsamości jest trudnym

wyzwaniem. Ale jeśli chcemy uwolnić potencjał takich mechanizmów, wydaje

się nieuniknione, że musimy zrobić wszystko, co w naszej mocy, aby

spróbować. Prawdą jest, że obecny dogmat dotyczący bezpieczeństwa

komputerowego, na przykład wprowadzenia głosowania online, to po prostu

„nie

rób tego". Jeśli jednak chcemy rozszerzyć rolę mechanizmów podobnych

do głosowania, w tym bardziej zaawansowanych form, takich jak głosowanie

kwadratowe i finansowanie kwadratowe, do większej liczby zadań, to nie

mamy innego wyjścia, jak stawić czoła wyzwaniu, zdecydowanie spróbować i

mieć nadzieję, że uda nam się zrobić coś wystarczająco bezpiecznego,

przynajmniej w niektórych zastosowaniach.

Zmowa

2000 Jan 01 See all postsSpecjalne podziękowania dla Glena Weyla, Phila Daiana i Jinglana Wanga za recenzję, i dla Dawida Kurdziela i bichvan2408 za tłumaczenie

W ciągu ostatnich kilku lat wzrosło zainteresowanie wykorzystaniem rozmyślnie skonstruowanych bodźców ekonomicznych i mechanizmów zaprojektowanych w celu dostosowania zachowania uczestników w różnych kontekstach. W przestrzeni blockchain konstrukcja mechanizmu przede wszystkim zapewnia bezpieczeństwo samego łańcucha bloków, zachęcając górników lub walidatorów proof of stake do uczciwego udziału, ale ostatnio jest on stosowany w rynkach prognoz, „tokenowo nadzorowanych rejestrach" i wielu innych kontekstach. Powstający ruch RadicalXChange zainicjował w międzyczasie eksperymenty z podatkami Harbergera, głosowaniem kwadratowym, finansowaniem kwadratowym i in. W ostatnim czasie wzrosło również zainteresowanie wykorzystaniem bodźców opartych na tokenach w celu promowania wysokiej jakości postów w mediach społecznościowych. Jednakże w miarę jak rozwój tych systemów przechodzi z teorii do praktyki, pojawia się szereg wyzwań, którym należy stawić czoła, a których, jak sądzę, jeszcze wystarczająco nie rozpoznano. Świeżym przykładem tego przejścia od teorii do wdrożenia jest Bihu, chińska platforma, która niedawno wypuściła oparty na monetach mechanizm zachęcania ludzi do pisania postów. Podstawowym mechanizmem (patrz white paper w języku chińskim tutaj) jest to, że jeśli użytkownik platformy posiada żetony KEY, ma możliwość postawienia tych żetonów na artykuły; każdy użytkownik może oddać

k„głosów poparcia" dziennie, a „waga" każdego głosu poparcia jest proporcjonalna do stawki użytkownika, który oddał głos. Artykuły z większą ilością udziałów w głosach poparcia są bardziej widoczne, a autor artykułu otrzymuje nagrodę w postaci tokenów KEY mniej więcej proporcjonalną do ilości głosów KEY popierających ten artykuł. Jest to wielkie uproszczenie, a rzeczywisty mechanizm ma w sobie pewne nieliniowości, ale nie są one niezbędne dla podstawowego funkcjonowania mechanizmu. KEY ma wartość, ponieważ może być używany na różne sposoby wewnątrz platformy, ale przede wszystkim procent wszystkich przychodów z reklam wykorzystywany jest do zakupu i spalania KEY (hura, wielkie brawa dla nich za to, a nie robienie jeszcze jednego medium do wymiany tokenów!). Ten rodzaj konstrukcji jest daleki od unikalności; zachęcanie do tworzenia treści online jest czymś, na czym bardzo wielu ludziom zależy i było wiele projektów o podobnym charakterze, jak również kilka dość odmiennych. I w tym przypadku ta konkretna platforma jest już w znacznym stopniu wykorzystywana:Kilka miesięcy temu, handlujący Ethereum subreddit /r/ethtrader wprowadził nieco podobną eksperymentalną funkcję, dzięki której token o nazwie „pączek" jest wydawany użytkownikom wyrażającym komentarze otrzymujące głosy poparcia, z ustaloną ilością pączków wydawanych tygodniowo użytkownikom proporcjonalnie do tego, ile głosów poparcia otrzymał ich komentarz. Pączki mogą być wykorzystane do zakupu prawa do umieszczenia treści bannera na górze subredditu, a także do głosowania w sondażach społecznościowych. Jednakże, w przeciwieństwie do tego, co dzieje się w systemie KEY, tutaj nagroda, którą otrzymuje B, gdy A zagłosuje na B, nie jest proporcjonalna do istniejącej liczby monet należących do A; zamiast tego, każde konto Reddit ma równą możliwość wpłaty na inne konta Reddit.

Tego rodzaju eksperymenty próbujące nagradzać tworzenie treści wysokiej jakości w sposób wykraczający poza znane ograniczenia darowizn/mikropłatności są bardzo cenne. Niedocenianie treści internetowych generowanych przez użytkowników jest istotnym problemem w społeczeństwie w ogóle (patrz „radykalizm liberalny" i „dane jako praca"). Otuchy dodaje fakt, że kryptospołeczności próbują wykorzystać siłę konstrukcji mechanizmu, by wejść na drogę do jego rozwiązania. Ale niestety, te systemy są również podatne na atak. Samogłosowanie, plutokracja i łapówki Oto jak można ekonomicznie zaatakować zaproponowany powyżej projekt. Załóżmy, że jakiś zamożny użytkownik nabywa pewną ilość

Ntokenów, a w rezultacie każdy z jegokgłosów daje odbiorcy nagrodę w wysokościN * q(qtutaj prawdopodobnie jest to bardzo mała liczba, np.q = 0,000001). Użytkownik po prostu głosuje na swoje własne konta kukiełkowe, dając sobie nagrodę w wysokościN * k * q. Następnie system po prostu się załamuje, a każdy użytkownik otrzymuje „stopę procentową" w wysokościk * qza okres, a mechanizm nie osiąga nic innego. Rzeczywisty mechanizm Bihu zdawał się to przewidywać i ma pewną superliniową logikę, w której artykuły z większą ilością głosów poparcia KEY uzyskują nieproporcjonalnie większą nagrodę, pozornie zachęcając raczej do poparcia popularnych postów niż do samodzielnego głosowania. Powszechnym wzorcem wśród systemów zarządzania głosowaniem za pomocą monet jest dodawanie tego rodzaju superliniowości, aby zapobiec osłabianiu całego systemu przez samogłosowanie. Większość systemów DPOS posiada ograniczoną liczbę slotów dla delegatów z zerowymi nagrodami dla każdego, kto nie otrzyma wystarczającej liczby głosów, aby dołączyć do jednego z slotów, z podobnym skutkiem. Jednak systemy te niezmiennie wprowadzają dwie nowe słabości:Ataki łapówkarskie mogą brzmieć zbyt przesadnie (kto tu kiedykolwiek w życiu przyjął łapówkę?), ale w dojrzałym ekosystemie są o wiele bardziej realistyczne, niż się wydaje. W większości kontekstów, w których łapówki miały miejsce w przestrzeni blockchain, operatorzy używają eufemistycznej nowej nazwy, aby nadać koncepcji przyjazną twarz: to nie jest łapówka, to „staking pool", która „rozdziela dywidendę". Łapówki można nawet zatuszować: wyobraź sobie kantor wymiany kryptowalut, który oferuje zerowe opłaty i wydaje pieniądze na niezwykle dobry interfejs użytkownika i nawet nie próbuje zebrać zysku. Zamiast tego używa monet, które użytkownicy wpłacają, aby uczestniczyć w różnych systemach głosowania za pomocą monet. Nieuchronnie pojawią się również ludzie, którzy będą postrzegać zmowę w grupie jako zwykłą, normalną rzecz. Przykładem może być niedawny skandal z udziałem EOS DPOS:

W końcu istnieje możliwość „negatywnej łapówki", tzn. szantażu lub przymusu, grożąc uczestnikom krzywdą, chyba że zadziałają oni w określony sposób wewnątrz mechanizmu. W eksperymencie /r/ethtrader strach przed ludźmi przychodzącymi i kupującymi pączki w celu zmiany sondaży zarządzających doprowadził do tego, że społeczność zdecydowała się na stworzenie tylko zablokowanych (tj. niepodlegających wymianie handlowej) pączków uprawnionych do wykorzystania w głosowaniu. Ale jest jeszcze tańszy atak niż kupowanie pączków (atak, który można uznać za rodzaj zamaskowanej łapówki): wynajmowanie ich. Jeśli napastnik posiada już ETH, może użyć go jako zabezpieczenia na platformie takiej jak Compound, aby pożyczyć jakiś token, dając Ci pełne prawo do użycia tego tokena w dowolnym celu, włączając w to udział w głosowaniu. Kiedy to zrobi, po prostu odsyła tokeny z powrotem do kontraktu pożyczki, aby odzyskać swoje zabezpieczenie - wszystko to bez konieczności znoszenia nawet jednej sekundy ekspozycji cenowej na token, którego użył do oddania głosu monetą, nawet jeśli mechanizm głosowania monetą zawiera blokadę czasową (jak np. Bihu). W każdym przypadku problemy związane z łapówkarstwem i przypadkowe nadmierne wzmocnienie dobrze powiązanych i zamożnych uczestników okazują się zaskakująco trudne do uniknięcia. Tożsamość Niektóre systemy próbują złagodzić plutokratyczne aspekty głosowania monetami poprzez wykorzystanie systemu tożsamości. W przypadku systemu pączków /r/ethtrader, na przykład, sondaże zarządzające są wprawdzie przeprowadzane za pomocą głosowania monetami, jednak mechanizm, który decyduje o tym, jak dużo pączków (tj. monet) otrzymujesz w pierwszej kolejności oparty jest na kontach Reddit: 1 głos poparcia z 1 konta Reddit = N zarobionych pączków. Idealnym celem systemu tożsamości jest sprawienie, by uzyskanie przez jednostkę jednej tożsamości było stosunkowo łatwe, natomiast uzyskanie wielu tożsamości - stosunkowo trudne. W systemie pączków /r/ethtrader są to konta Reddit, a w gadżecie dopasowującym Gitcoin CLR używane są konta Githuba. Ale tożsamość, przynajmniej dotychczas implementowana, jest delikatną rzeczą...

Och, jesteś zbyt leniwy, żeby zrobić duży stojak z telefonami? Cóż, może szukasz tego:

Zwykłe ostrzeżenie o możliwych nieuczciwych praktykach na tych stronach jest tego warte: przeprowadzaj własne badania i zachowaj czujność.

Prawdopodobnie, atakowanie tych mechanizmów poprzez zwykłe kontrolowanie tysięcy fałszywych tożsamości jak władca marionetek jest nawet łatwiejsze niż konieczność przekupywania ludzi. A jeśli uważasz, że odpowiedzią jest po prostu zwiększenie bezpieczeństwa do poziomu rządowych dokumentów tożsamości? Cóż, jeśli chcesz zdobyć kilka z nich, możesz zacząć poszukiwania tutaj ale pamiętaj, że istnieją wyspecjalizowane organizacje przestępcze, które są daleko przed tobą. Nawet jeśli wszystkie struktury przestępcze zostałyby rozbite, istnieją wrogie rządy, które na pewno stworzą miliony sfałszowanych paszportów, jeśli będziemy na tyle głupi, by stworzyć systemy, które sprawią, że tego rodzaju działalność będzie opłacalna. I nie obejmuje to nawet ataków w odwrotnym kierunku, gdy instytucje wydające dokumenty tożsamości próbują zepchnąć na margines społeczności poprzez odmawianie im dokumentów tożsamości... Zmowa Biorąc pod uwagę, że tak wiele mechanizmów wydaje się podobnie zawodzić, kiedy w grę wchodzi wiele tożsamości lub nawet płynnych rynków, można zapytać, czy istnieje jakiś głęboki wspólny aspekt, który powoduje te wszystkie problemy? Twierdzę, że odpowiedź brzmi „tak", a „wspólny aspekt" jest następujący: o wiele trudniejsze, a zapewne wręcz niemożliwe jest stworzenie mechanizmów, które zachowują pożądane właściwości w modelu, w którym uczestnicy mogą się zmawiać, niż w modelu, w którym nie mogą. Większość ludzi prawdopodobnie ma już pewne przeczucia na ten temat; konkretne realizacje tej zasady są źródłem dobrze ugruntowanych norm i często przepisów prawa promujących konkurencję na rynku i ograniczających działania karteli ustalających ceny, kupowanie i sprzedawanie głosów oraz przekupstwo. Ale problem jest o wiele głębszy i bardziej powszechny. W tej wersji teorii gier, która skupia się na indywidualnym wyborze - czyli w wersji, która zakłada, że każdy uczestnik podejmuje decyzje samodzielnie i która nie dopuszcza możliwości pracy grup agentów działających wspólnie dla wzajemnych korzyści, istnieją matematyczne dowody, że w każdej grze musi istnieć przynajmniej jedna stabilna równowaga Nasha, a projektanci mechanizmów mają bardzo dużą swobodę w „konstruowaniu" gier, aby osiągnąć konkretne wyniki. Ale w wersji teorii gier, która dopuszcza możliwość koalicji pracujących razem, zwanej teorią gier kooperacyjnych, istnieją duże klasy gier które nie mają stabilnego wyniku, od którego koalicja nie może się zyskownie różnić. Gry większościowe - formalnie opisane jako gry

Nagentów, gdzie dowolny podzbiór ponad połowy z nich może zdobyć stałą nagrodę i podzielić ją między sobą; konfiguracja bardzo podobna do wielu sytuacji w zakresie ładu korporacyjnego, polityki i wielu innych sytuacji z życia człowieka - są częścią tego zbioru z natury niestabilnych gier. Oznacza to, że jeśli istnieje sytuacja z pewną stałą pulą zasobów i pewnym obecnie ustalonym mechanizmem ich dystrybucji, a 51% uczestników może nieuchronnie spiskować w celu przejęcia kontroli nad zasobami, bez względu na to, jaka jest obecna konfiguracja, zawsze może pojawić się jakiś spisek, który byłby korzystny dla uczestników. Spisek ten byłby jednak z kolei narażony na potencjalne nowe konspiracje, w tym być może kombinację poprzednich spiskowców i ofiar... i tak dalej i tak dalej.Ten fakt, niestabilność gier większościowych w ramach teorii gier kooperacyjnych, jest prawdopodobnie bardzo niedoceniany jako uproszczony ogólny model matematyczny wyjaśniający, dlaczego w polityce nie może być żadnego „końca historii" i żadnego systemu, który okazałby się w pełni zadowalający. Osobiście uważam, że jest on o wiele bardziej użyteczny niż bardziej znane twierdzenie Arrowa, na przykład. Są dwa sposoby na obejście tego problemu. Pierwszym z nich jest próba ograniczenia nas samych do klasy gier, które są „wolne od tożsamości" i „odporne na zmowy", żebyśmy nie musieli martwić się ani o łapówki, ani o tożsamość. Drugim jest bezpośrednie zajęcie się problemami tożsamości i odporności na zmowy i rzeczywiste rozwiązanie ich wystarczająco dobrze, aby wdrożyć gry bez zmowy, oferujące lepsze funkcje. Projekt gry bez tożsamości i odpornej na zmowy.Klasa gier wolnych od tożsamości i odpornych na zmowy ma zasadnicze znaczenie. Nawet proof of work jest odporny na zmowy aż do momentu, w którym jeden aktor ma ~23,21% całkowitej mocy haszowania, a ta wartość może być zwiększona do 50% przy użyciu sprytnej inżynierii. Rynki konkurencyjne są całkiem odporne na zmowy do stosunkowo wysokiej wartości granicznej, która w niektórych przypadkach jest łatwo osiągalna, a w innych nie. W przypadku nadzorowania i kontroli treści (które tak naprawdę są tylko szczególnymi przypadkami ogólnego problemu identyfikacji publicznych dóbr i publicznych krzywd) główną klasą dobrze funkcjonującego mechanizmu jest futarchia - zazwyczaj przedstawiana jako „zarządzanie przez rynek prognostyczny", choć twierdzę również, że korzystanie z depozytów zabezpieczających jest zasadniczo w tej samej klasie technologii. Sposób, w jaki działają mechanizmy futarchii, w swojej najbardziej ogólnej formie, polega na tym, że „głosowanie" jest nie tylko wyrażeniem opinii, ale także przewidywaniem, z nagrodą za tworzenie prawdziwych przepowiedni i karą za tworzenie fałszywych. Na przykład moja propozycja dla „rynków przewidywań dla DAO nadzorujących treści" sugeruje na wpół scentralizowaną konstrukcję, gdzie każdy może zagłosować lub odrzucić nadesłane treści, z treścią na którą oddaje się więcej głosów poparcia, gdzie istnieje również „panel moderacyjny", który podejmuje ostateczne decyzje. Dla każdego wpisu istnieje małe prawdopodobieństwo (proporcjonalne do całkowitej liczby głosów za i przeciw na dany wpis), że panel moderacyjny zostanie wezwany do podjęcia ostatecznej decyzji w sprawie wpisu. Jeśli panel moderacyjny zatwierdzi dany wpis, każdy, kto go na niego głosował jest nagradzany, a każdy kto głosował przeciw, jest karany, a jeśli panel moderacyjny nie zatwierdzi wpisu, następuje sytuacja odwrotna; mechanizm ten zachęca uczestników do wymyślenia głosów, które starają się „przewidzieć" osąd panelu moderacyjnego. Innym możliwym przykładem futarchii jest system zarządzania projektem z użyciem tokena, w którym każdy, kto głosuje za decyzją, jest zobowiązany do zakupu pewnej ilości tokenów po cenie w momencie rozpoczęcia głosowania, jeśli głosowanie wygra. Gwarantuje to, że głosowanie za złą decyzją jest kosztowne, a w skrajnych przypadkach, jeśli zła decyzja wygra głosowanie, każdy kto ją zatwierdził, musi zasadniczo wykupić wszystkich innych w projekcie. Gwarantuje to, że indywidualne głosowanie za „niewłaściwą" decyzją może być bardzo kosztowne dla wyborcy, wykluczając możliwość tanich ataków łapówkarskich.

Opis graficzny jednej z form futarchii, tworzącej dwa rynki reprezentujące dwa „możliwe przyszłe światy" i wybierającej ten, który ma korzystniejszą cenę. Źródło ten post na ethresear.ch

Jednak zakres tego, co tego typu mechanizmy mogą robić, jest ograniczony. W powyższym przykładzie nadzoru treści nie rozwiązujemy tak naprawdę kwestii zarządzania, po prostu skalujemy funkcjonalność gadżetu zarządzającego, który już został uznany za godny zaufania. Można by spróbować zastąpić panel moderacyjny rynkiem predykcyjnym w oparciu o cenę tokena reprezentującego prawo do zakupu powierzchni reklamowej, ale w praktyce ceny są zbyt hałaśliwym wskaźnikiem, aby było to wykonalne dla czegokolwiek oprócz bardzo małej liczby bardzo dużych decyzji. I często wartość, którą staramy się zmaksymalizować, jest wyraźnie czymś innym niż maksymalna wartość monety. Przyjrzyjmy się dokładniej, dlaczego w bardziej ogólnym przypadku, gdy nie możemy łatwo określić wartości decyzji dotyczącej zarządzania poprzez jej wpływ na cenę tokena, dobre mechanizmy identyfikacji dóbr i krzywd publicznych nie mogą być niestety wolne od tożsamości lub odporne na zmowy. Jeśli ktoś próbuje zachować własność gry wolnej od tożsamości, budując system, w którym tożsamość nie ma znaczenia i mają ją tylko monety, istnieje niemożliwy do osiągnięcia kompromis pomiędzy brakiem zachęt do korzystania z legalnych dóbr publicznych, a nadmiernym subsydiowaniem plutokracji. Argumentacja jest następująca. Przypuśćmy, że jest jakiś autor, który wytwarza dobro publiczne (np. serię postów na blogu), które zapewnia wartość każdemu członkowi społeczności liczącej 10 000 osób. Przypuśćmy, że istnieje pewien mechanizm, w którym członkowie społeczności mogą podjąć działanie powodujące, że autor otrzymuje zysk w wysokości 1\(. O ile członkowie społeczności nie są *niezwykle* altruistyczni, to aby mechanizm działał, koszt podjęcia tej akcji musi być znacznie niższy niż 1\), ponieważ w przeciwnym razie część korzyści odniesionych przez członka społeczności wspierającego autora byłaby znacznie mniejsza niż koszt wsparcia autora, a więc system popada w tragedię wspólnoty, gdzie nikt nie wspiera autora. Dlatego musi istnieć sposób na to, aby autor zarobił 1$ przy koszcie znacznie mniejszym niż 1\(. Ale teraz załóżmy, że istnieje również fałszywa społeczność, która składa się z 10 000 fałszywych kont marionetkowych tego samego bogatego atakującego. Ta społeczność podejmuje wszystkie te same działania, co prawdziwa społeczność, z wyjątkiem tego, że zamiast wspierać autora, wspomaga *inne* fałszywe konto, które jest również marionetką atakującego. Jeśli członek „prawdziwej społeczności" mógł dać autorowi 1\) przy osobistym koszcie znacznie mniejszym niż 1$, to jest możliwe by napastnik dał samemu sobie\(1 przy koszcie znacznie mniejszym niż 1\) za każdym razem, a tym samym wyczerpał fundusze systemu. Każdy mechanizm, który może naprawdę pomóc słabo skoordynowanym stronom w koordynowaniu bez odpowiednich zabezpieczeń, pomoże również już skoordynowanym stronom (takim jak wiele kont kontrolowanych przez tę samą osobę) nadmiernie skoordynowanie, wydobywając pieniądze z systemu. Podobne wyzwanie pojawia się, gdy celem nie jest finansowanie, ale raczej określenie, jaka treść powinna być najbardziej widoczna. Jaka treść, twoim zdaniem, otrzymałaby większą wspierającą wartość dolarową: prawdziwie wysokiej jakości artykuł blogowy przynoszący korzyści tysiącom ludzi, choć każda osoba korzysta z niego stosunkowo nieznacznie, czy to?

A może to?

Ci, którzy śledzili niedawne wydarzenia polityczne na świecie, mogą również wskazać na inny rodzaj treści, który przynosi korzyści wysoce scentralizowanym aktorom: manipulację mediami społecznościowymi przez wrogie rządy. Ostatecznie zarówno systemy scentralizowane, jak i zdecentralizowane stoją przed tym samym fundamentalnym problemem, który polega na tym, że „rynek idei" (i ogólnie dóbr publicznych) jest bardzo daleki od „efektywnego rynku" w sensie zwykle używanym przez ekonomistów, a to prowadzi zarówno do niedoboru dóbr publicznych nawet w „czasie pokoju", jak i podatności na aktywne ataki. To po prostu poważny problem. Dlatego też systemy głosowania oparte na monetach (takie jak Bihu) mają jedną główną przewagę nad systemami opartymi na tożsamości (jak Gitcoin CLR lub eksperyment z pączkami /r/ethtrader): przynajmniej nie ma żadnej korzyści z masowego kupowania kont, ponieważ wszystko, co robisz, jest proporcjonalne do tego ile masz monet, niezależnie od tego, na ile kont są one podzielone. Jednakże mechanizmy, które nie opierają się na żadnym modelu tożsamości i zasadniczo opierają się jedynie na monetach, nie mogą rozwiązać problemu skoncentrowanych interesów, które wygrywają z rozproszonymi społecznościami starającymi się wspierać dobra publiczne. Wolny od tożsamości mechanizm, który wzmacnia rozproszone społeczności, nie może uniknąć nadmiernego wzmocnienia scentralizowanych plutokratów udających rozproszone społeczności. Ale nie chodzi tylko o kwestie tożsamości, na które narażone są również gry związane z dobrami publicznymi; chodzi też o łapówki. Aby zobaczyć dlaczego, rozważmy ponownie powyższy przykład, gdzie zamiast „fałszywej społeczności", którą jest 10001 marionetek atakującego, atakujący ma tylko jedną tożsamość, konto otrzymujące fundusze, a pozostałe 10 000 kont to prawdziwi użytkownicy - ale użytkownicy otrzymujący łapówkę po 0,01$ każdy, za podjęcie akcji, która spowodowałaby, że atakujący zyskałby dodatkowy 1$. Jak wspomniano powyżej, łapówki te mogą być w znacznym stopniu zatuszowane, nawet poprzez usługi powiernicze świadczone przez osoby trzecie, które głosują w imieniu użytkownika w zamian za wygody, a w przypadku modeli „głosujących monetami" zatuszowanie łapówki jest jeszcze łatwiejsze: można to zrobić poprzez wypożyczenie monet na rynku i wykorzystanie ich do udziału w głosowaniu. Zatem, o ile niektóre rodzaje gier, w szczególności gier opartych na rynku przewidywań lub na depozytach zabezpieczających, można uczynić odpornymi na zmowy i pozbawionymi tożsamości, o tyle uogólnione finansowanie dóbr publicznych wydaje się klasą problemów, w której niestety nie da się zastosować podejścia odpornego na zmowy i pozbawionego tożsamości. Odporność na zmowy i tożsamość Inną alternatywą jest atakowanie problemu tożsamości bezpośrednio. Jak wspomniano powyżej, samo przejście na scentralizowane systemy tożsamości o wyższym poziomie bezpieczeństwa, takie jak paszporty i inne rządowe dokumenty tożsamości, nie będzie działać na dużą skalę; w sytuacji wielu zachęt są one bardzo niepewne i podatne na zagrożenia ze strony samych rządów wydających dokumenty! Rodzaj „tożsamości", o której tutaj mówimy, jest raczej pewnego rodzaju solidnym wieloczynnikowym zbiorem twierdzeń, że aktor identyfikowany przez pewien zbiór komunikatów jest w rzeczywistości niepowtarzalną jednostką. Bardzo wczesnym prototypowym modelem tego rodzaju tożsamości sieciowej jest prawdopodobnie społeczny mechanizm odzyskiwania kluczy w blockchainowym telefonie HTC:

Podstawową ideą jest to, że Twój klucz prywatny jest podzielony w tajemnicy pomiędzy maksymalnie pięć zaufanych kontaktów, w taki sposób, że matematycznie zapewnia, iż trzy z nich mogą odzyskać oryginalny klucz, ale dwa lub mniej nie mogą. Kwalifikuje się to jako „system tożsamości" - to piątka Twoich przyjaciół decyduje o tym, czy ktoś, kto próbuje odzyskać Twoje konto, to Ty, czy nie. Jest to jednak system tożsamości specjalnego przeznaczenia, próbujący rozwiązać problem - bezpieczeństwa konta osobistego - który różni się od (i jest łatwiejszy niż!) problemu próby identyfikacji konkretnych osób. Podsumowując, ogólny model konkretnych osób składających oświadczenia o sobie nawzajem może być prawdopodobnie powiązany z jakimś bardziej solidnym modelem tożsamości. Systemy te mogą być w razie potrzeby rozszerzone przy użyciu opisanego powyżej mechanizmu „futarchii": jeśli ktoś twierdzi, że ktoś jest konkretną osobą, a ktoś inny się na to nie zgadza, a obie strony są skłonne nawiązać współpracę w celu rozstrzygnięcia sprawy, system może zwołać zespół orzekający w celu ustalenia, kto ma rację. Ale chcemy też innej niezwykle istotnej własności: chcemy tożsamości, której nie można wiarygodnie wynająć ani sprzedać. Oczywiście, nie możemy przeszkodzić ludziom w zawarciu umowy typu „wyślij mi 50 dolarów, a ja wyślę ci mój klucz", ale możemy spróbować zapobiegać wiarygodności takich transakcji - zrobić tak, aby sprzedający mógł łatwo oszukać kupującego i dać mu klucz, który tak naprawdę nie działa. Jednym ze sposobów dokonania tego jest stworzenie mechanizmu, dzięki któremu właściciel klucza może wysłać transakcję, która unieważnia klucz i zastępuje go innym, wybranym przez właściciela, a wszystko to w sposób, którego nie można udowodnić. Być może najprostszym sposobem na obejście tego problemu jest albo użycie zaufanej strony, która przeprowadza obliczenia i publikuje tylko wyniki (wraz z dowodami z wiedzą zerową potwierdzającymi wyniki, więc zaufana strona jest zaufana tylko dla prywatności, a nie integralności), albo zdecentralizowanie tej samej funkcjonalności dzięki wielopodmiotowym obliczeniom. Takie podejście nie rozwiąże całkowicie problemu zmowy; grupa przyjaciół mogłaby nadal spotykać się na tej samej kanapie i koordynować głosowania, ale przynajmniej ograniczy ją w możliwym do opanowania stopniu, który nie doprowadzi do całkowitego upadku tych systemów. Jest jeszcze jeden problem: wstępna dystrybucja klucza. Co się stanie, jeśli użytkownik stworzy swoją tożsamość w zewnętrznym serwisie powierniczym, który następnie przechowuje klucz prywatny i używa go do potajemnego głosowania? Byłaby to ukryta łapówka, siła głosu użytkownika w zamian za dostarczenie użytkownikowi wygodnej usługi, a co więcej, jeśli system jest bezpieczny w tym sensie, że skutecznie zapobiega łapówkom poprzez uczynienie głosów niepoprawnymi, tajne głosowanie przez zewnętrznych gospodarzy byłoby również niewykrywalne. Jedynym podejściem, które omija ten problem wydaje się... weryfikacja osobista. Na przykład można mieć ekosystem „emitentów", w którym każdy emitent wydaje karty elektroniczne z kluczami prywatnymi, które użytkownik może natychmiast pobrać na swój smartfon i wysłać wiadomość, aby zastąpić klucz innym kluczem, którego nikomu nie ujawni. Emitentami tymi mogą być spotkania i konferencje lub potencjalnie osoby, które przez mechanizm głosowania zostały już uznane za godne zaufania. Budowanie infrastruktury umożliwiającej tworzenie mechanizmów odpornych na zmowy, w tym solidnych, zdecentralizowanych systemów tożsamości jest trudnym wyzwaniem. Ale jeśli chcemy uwolnić potencjał takich mechanizmów, wydaje się nieuniknione, że musimy zrobić wszystko, co w naszej mocy, aby spróbować. Prawdą jest, że obecny dogmat dotyczący bezpieczeństwa komputerowego, na przykład wprowadzenia głosowania online, to po prostu „nie rób tego". Jeśli jednak chcemy rozszerzyć rolę mechanizmów podobnych do głosowania, w tym bardziej zaawansowanych form, takich jak głosowanie kwadratowe i finansowanie kwadratowe, do większej liczby zadań, to nie mamy innego wyjścia, jak stawić czoła wyzwaniu, zdecydowanie spróbować i mieć nadzieję, że uda nam się zrobić coś wystarczająco bezpiecznego, przynajmniej w niektórych zastosowaniach.